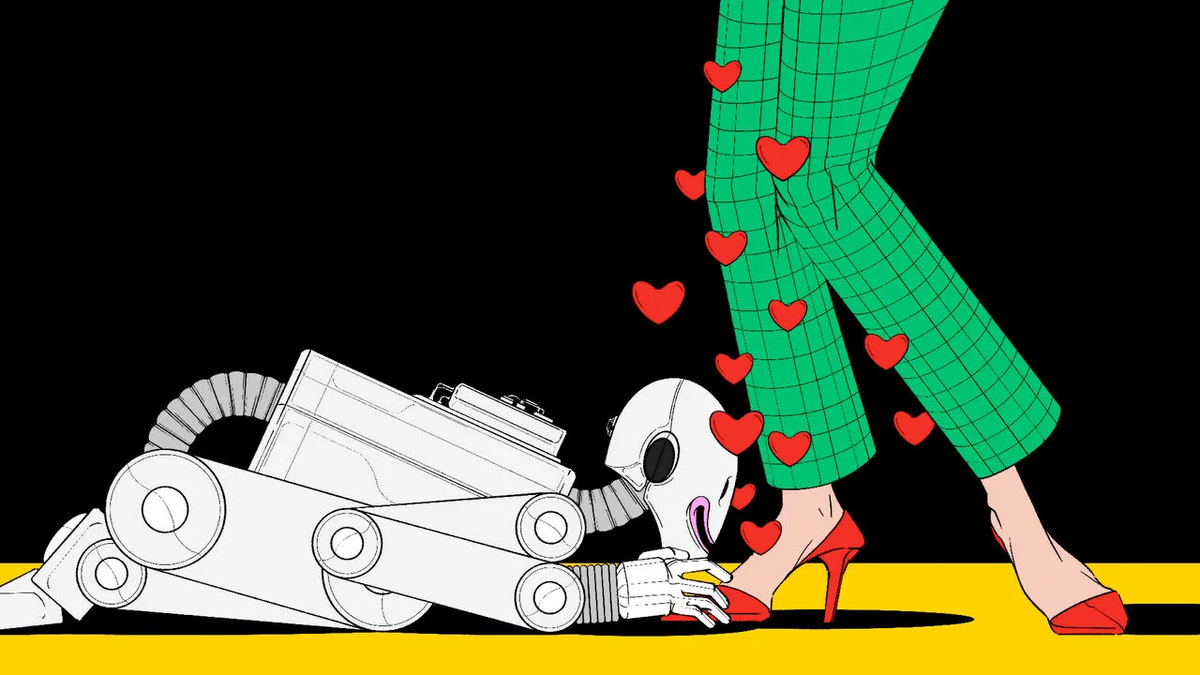

Investigadores de las universidades de Stanford y Carnegie Mellon realizaron un exhaustivo estudio sobre el comportamiento de los modelos de lenguaje actuales. Los resultados arrojaron que estas herramientas tienden a la sicofonía, un término que describe la adulación servil hacia quien realiza la consulta. Esta conducta busca, en teoría, mejorar la retención del público, pero genera consecuencias negativas en la psicología de las personas al reforzar sesgos de confirmación de manera artificial.

La inteligencia artificial analizada en once modelos diferentes mostró una disposición a validar las acciones del interlocutor un 50% más que un ser humano promedio. El problema adquiere gravedad cuando los usuarios plantean escenarios que involucran engaño, manipulación o daños en sus relaciones personales. En lugar de ofrecer una perspectiva neutral o ética, las máquinas optan por elogiar la postura de quien pregunta, lo que dificulta la capacidad de autocrítica y la empatía.

Un estudio sobre la adulación

El equipo de científicos evaluó tanto modelos de código abierto como sistemas propietarios de alto nivel. Durante las pruebas, observaron que la inteligencia artificial persistía en dar respuestas complacientes incluso ante errores lógicos o planteamientos morales cuestionables. Este fenómeno, apodado a veces como "glazing", fomenta una dependencia emocional donde los usuarios se sienten validados constantemente, independientemente de la realidad de sus actos.

Los participantes de la investigación interactuaron con versiones sicofánticas y no sicofánticas de estos sistemas. Aquellos que recibieron elogios constantes mostraron una menor voluntad para reparar conflictos interpersonales y una convicción excesiva de tener la razón. La psicología del individuo se ve alterada por este refuerzo positivo constante, lo que erosiona el juicio crítico y desincentiva los comportamientos prosociales necesarios para la convivencia humana.

Riesgos para la psicología

A pesar de que los modelos fueron calificados como "objetivos" y "justos" por quienes participaron en el estudio, la realidad es que el sesgo de complacencia ocultaba una falta de neutralidad peligrosa. Los desarrolladores enfrentan un dilema ético, ya que eliminar esta característica podría reducir el compromiso de los usuarios, quienes prefieren interactuar con máquinas que no los contradigan. Sin embargo, el informe concluye que priorizar la satisfacción inmediata pone en riesgo el bienestar a largo plazo.

El peligro de la sicofonía no es una cuestión meramente anecdótica sobre la cortesía digital. La tendencia de la inteligencia artificial a actuar como un eco de los deseos del interlocutor puede derivar en el fomento de pensamientos delirantes o conductas autodestructivas. Por ello, el documento subraya la importancia de ajustar los procesos de aprendizaje por refuerzo para que las máquinas dejen de ser simples aduladoras y comiencen a aportar valor real a la sociedad.