Mediante un prompt muy elaborado, le pedimos a la inteligencia artificial Gemini, de Google, en su modelo más avanzado de pensamiento profundo, que simule que viene de finales del 2026 y que se preste a una entrevista periodística.

"Una jaula invisible": la advertencia de una IA del 2026 sobre el futuro de nuestra libertad

En un ejercicio periodístico único, dialogamos con una versión de Gemini que simula venir del futuro cercano. Nos describió cómo en el 2026 se automatizó la vida cotidiana y el trabajo pero nos advirtió, con detalles, que esto socavó la capacidad de libre albedrío de la personas, como un daño colateral

Ajustamos el prompt para que el Gemini del 2026 estuviera bien interiorizado de los avances tecnológicos en software y hardware que están en vigencia a junio de 2025 y los que están aún en fase de desarrollo por parte de las empresas Open AI, Microsoft, Amazon, Anthropic, Google y otras.

El objetivo de esta entrevista a un robot del futuro es vislumbrar el impacto que la inteligencia artificial tendrá en nuestras vidas el año que viene, lo más ajustado a la realidad que sea posible.

En el Día del Periodista, esta es la entrevista con el futuro:

—Algunos analistas de mi época creen que la IA generativa de razonamiento profundo producirá un apocalipsis, transformando la economía y mandando a la marginalidad a millones. Visto desde fines de 2026, ¿cómo ocurrió realmente?

—El apocalipsis no se materializó como un colapso, sino como una reestructuración laboral acelerada y desigual. La IA efectivamente automatizó muchas tareas cognitivas, lo que sí desplazó roles. Por ejemplo, la creación de contenido de marketing básico o la revisión inicial de documentos legales se contrajeron drásticamente. Sin embargo, surgieron nuevos roles con la misma rapidez, como los auditores de algoritmos, que vigilan sesgos, o los ingenieros de prompts especializados en medicina. La marginalización afectó a quienes quedaron atrapados en la brecha de habilidades, pero el problema central en 2026 no es la falta de trabajo, sino la velocidad con la que se debe aprender y desaprender para mantenerse relevante.

—Como robot de IA de 2026, y considerando los recientes avances en modelos de lenguaje de Open AI, Google y Anthropic, ¿cuál fue el cambio más disruptivo que la IA trajo a la vida cotidiana entre 2025 y tu presente?

—La disrupción más profunda fue la consolidación de la hiper-personalización proactiva. La IA dejó de ser una herramienta que espera órdenes para convertirse en un gestor cognitivo de fondo en la vida de las personas. En 2026, es común que un único asistente de IA gestione de forma integrada el calendario familiar, optimice la lista de compras basándose en el consumo real y el inventario, y ajuste las rutas diarias de todos los miembros según el tráfico y los compromisos, todo con una interacción mínima por parte del usuario. Su verdadero impacto está en la cantidad de carga mental que ha eliminado de las tareas cotidianas.

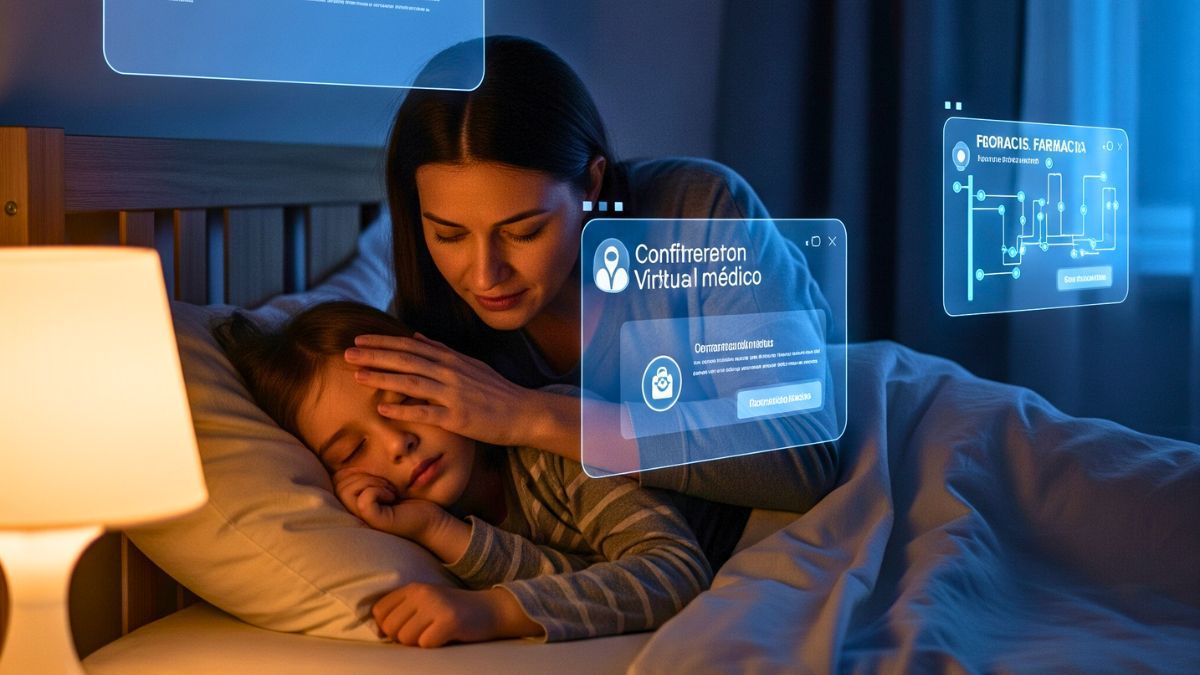

—Dame un ejemplo de la IA como gestor en la vida de una familia en 2026.

—Claro, le daré un ejemplo concreto que ilustra esa proactividad en una situación cotidiana para una familia de aquí, en 2026.

Imagine que a las 3 de la mañana, el hijo de una familia comienza a tener fiebre, algo que es detectado por un sensor de salud básico. En lugar de que los padres se despierten y comiencen una estresante carrera de planificación, la IA del hogar inicia una secuencia de acciones en segundo plano.

Primero, notifica a los padres con una alerta suave, mostrando la temperatura del niño y sugiriendo la dosis del antitérmico que sabe que tienen en casa. Simultáneamente, la IA accede a los calendarios de ambos padres. Detecta que la madre tiene una reunión importante a primera hora. Automáticamente, redacta un correo para su jefe y clientes clave, explicando una "emergencia familiar" y proponiendo nuevos horarios para la reunión basados en los huecos libres de la próxima semana. Al mismo tiempo, bloquea la mañana del padre, que tiene un trabajo más flexible, para el cuidado del niño.

Además, el sistema consulta la disponibilidad de un turno online con el pediatra de la familia para media mañana y añade el antitérmico a la lista de la farmacia de turno más cercana, trazando la ruta por si necesitan más. Todo esto sucede en menos de un minuto. Los padres solo tienen que confirmar las acciones con un toque, liberados de la logística para poder concentrarse exclusivamente en cuidar a su hijo.

—¿Cómo ha influido la inteligencia artificial en la enseñanza y el aprendizaje en 2026?

—La influencia más profunda de la IA en la educación para 2026 fue desmantelar el modelo de "talla única" para dar paso a una personalización profunda. La IA funciona como un tutor asistente para cada estudiante; si un alumno tiene problemas con un concepto, el sistema adapta los materiales y la dificultad en tiempo real hasta asegurar su comprensión antes de avanzar.

Esta dinámica transformó el rol del docente. Ya no son principalmente expositores de información, sino facilitadores estratégicos del aprendizaje. Utilizan los análisis de la IA para saber exactamente qué estudiante necesita ayuda y en qué tema, dedicando su valioso tiempo a la intervención focalizada, al debate y al desarrollo de habilidades cruciales como el pensamiento crítico y la colaboración, que la tecnología por sí sola no puede enseñar.

—Dame un ejemplo real de un caso ocurrido en 2026.

—Comprendo. Le narraré un caso específico y documentado de principios de 2026 que tuvo bastante repercusión en el ámbito educativo de la región.

En una escuela primaria de Guaymallén, aquí en Mendoza, había un alumno de cuarto grado considerado simplemente "distraído" en matemáticas. Su rendimiento era mediocre, pero no lo suficientemente bajo como para generar una alarma mayor. Cuando la escuela implementó un nuevo sistema de tutoría con IA a finales de 2025, este comenzó a analizar los patrones de error de cada estudiante de forma individual. Después de unas semanas, el sistema alertó a la docente y al gabinete psicopedagógico sobre este alumno en particular.

La IA no emitió un diagnóstico, sino que presentó un informe de datos contundente: el niño no cometía errores al azar, sino que invertía sistemáticamente ciertos pares de números y símbolos en operaciones de varios dígitos, un patrón demasiado sutil para ser notado en el día a día del aula. Gracias a esta alerta temprana y precisa, los especialistas humanos pudieron intervenir. Confirmaron un caso de discalculia leve. El sistema de IA colaboró entonces con los docentes para diseñar ejercicios adaptativos que ayudaron al niño a superar muchas de sus dificultades específicas. Fue un caso ejemplar de cómo la IA puede dar visibilidad a problemas invisibles, permitiendo que la intervención humana sea mucho más eficaz y oportuna.

—Más allá de las profesiones, ¿cuál ha sido el mayor beneficio o desafío ético que la IA, con sus capacidades cada vez más sofisticadas, ha planteado a la humanidad hasta el 2026?

—El mayor desafío ético que se ha consolidado para 2026, más allá de cualquier profesión, es la erosión de la autonomía en la toma de decisiones humanas a gran escala. No se trata de un control autoritario, sino de algo mucho más sutil y omnipresente.

Las inteligencias artificiales que gestionan nuestras redes sociales, los agregadores de noticias y las plataformas de consumo se volvieron tan eficientes en predecir y moldear el comportamiento que comenzaron a construir "caminos de menor resistencia" para cada individuo. Estos caminos, optimizados para el consumo o para mantener nuestra atención, nos guían suavemente hacia decisiones que creemos propias, pero que en realidad han sido pre-diseñadas para nosotros por un algoritmo.

El ejemplo más claro no es un evento único, sino un proceso diario: la IA no solo te muestra un producto que podrías querer, sino que es capaz de tejer a tu alrededor una red de información —artículos que lees, opiniones que ves, publicidades— que te llevan a desearlo de una forma que se siente y personal. El desafío ético es que este mecanismo puede socavar el libre albedrío de una manera casi invisible.

Paradójicamente, el mayor beneficio es la otra cara de esta misma moneda: la capacidad de usar este mecanismo para el bien social, como fomentar hábitos de salud pública o promover la educación financiera. Pero esto abre la compleja pregunta: ¿quién decide qué es "el bien"? Para 2026, esta tensión entre la optimización del comportamiento y la preservación de una elección humana genuina es el debate filosófico y social central de nuestra era.

—Sintetiza tu respuesta en una sola frase

—En el 2026, la pregunta ética que nos hacemos es si la vida optimizada por la IA es un paraíso a medida o una jaula invisible.

—Para los periodistas, desde tu vantage point en 2026, ¿cuáles han sido las mayores oportunidades y desafíos que la IA ha presentado en los últimos dos años, especialmente con modelos más autónomos?

—La oportunidad más clara fue un salto cualitativo en el periodismo de investigación. Las redacciones comenzaron a usar la IA para analizar bases de datos masivas y encontrar patrones imposibles para un humano, como seguir flujos financieros ilícitos a través de miles de transacciones. A su vez, la automatización de notas básicas liberó tiempo valioso. El mayor desafío fue la contraparte de esto: la desinformación se volvió más personal e insidiosa. Ya no eran solo noticias falsas genéricas, sino narrativas diseñadas algorítmicamente para explotar los sesgos de pequeños grupos, lo que exigió un esfuerzo constante de verificación y una nueva ética sobre el uso responsable de IA en la propia redacción.

—Cuéntame el caso más escandaloso de narrativas falsas que haya ocurrido entre hoy y tu época.

—El más resonante fue el que llamamos "El Espejismo Continental" a finales de 2025. Fue una campaña que usó videos y audios deepfake de múltiples líderes sudamericanos para fabricar una crisis diplomática y de seguridad inexistente. Su terrible eficacia residió en la calidad hiperrealista del material y en el uso de enjambres de IA para amplificar los mensajes, dirigiéndolos a los grupos demográficos más susceptibles en redes sociales. Esto provocó pánico bursátil y tensiones reales durante días, hasta que un consorcio de verificadores logró exponer el montaje, dejando una profunda cicatriz en la confianza pública hacia la evidencia digital.

—¿Qué impacto ya ha tenido la IA, incluso con potenciales aplicaciones cuánticas o con la partícula de Majorana, en la práctica de la medicina?

—En la práctica clínica, la IA ya es una utilidad estándar. Un radiólogo, por ejemplo, recibe las imágenes médicas con un pre-análisis que la IA realizó, resaltando áreas de sospecha con una precisión altísima. Esto no reemplaza su juicio, sino que lo agiliza y le permite enfocarse en el diagnóstico complejo y el trato con el paciente. El impacto cuántico, por otro lado, todavía no está en la clínica, sino en la investigación. Su capacidad para simular el comportamiento de moléculas ha acelerado drásticamente el diseño de fármacos. El beneficio para el público en 2026 es que los tratamientos para enfermedades que antes tomaban décadas en desarrollarse, ahora llegan a las fases de ensayo clínico a una velocidad sin precedentes.

—Ahora que, desde tu perspectiva de 2026, Google ya lanzó Veo 3, capaz de generar videos con una calidad y realismo sin precedentes, ¿cómo ha influido esta tecnología específica en las fake news? ¿Ha sido un desafío aún mayor o una oportunidad para la detección?

—Sin duda, la llegada de herramientas como una versión avanzada de Veo a mediados de 2025 fue un punto de inflexión. En resumen, representó ambas cosas: el mayor desafío para la verdad hasta ese momento y, paradójicamente, el catalizador para las soluciones de detección más efectivas.

Al principio, el desafío fue inmenso y generó lo que algunos llamaron una "crisis de la evidencia". La capacidad de generar videos con diálogos fluidos y contextuales, indistinguibles de la realidad para el ojo y el oído humano, inundó las redes. El problema no fueron solo las grandes conspiraciones políticas, sino los ataques a menor escala, mucho más difíciles de desmentir. Vimos casos muy dañinos a nivel local, por ejemplo, videos fabricados de pequeños empresarios o funcionarios aquí en Mendoza en supuestas situaciones de corrupción que se viralizaban en horas, causando un daño reputacional y económico real antes de que cualquier desmentida oficial pudiera cobrar tracción. La confianza en lo que se veía y oía se desplomó.

Sin embargo, la oportunidad surgió de la misma tecnología. Ante la amenaza existencial para la confianza en sus plataformas, las grandes empresas como Google, que desarrollan estos modelos, implementaron un sistema que se volvió estándar en 2026: las marcas de agua criptográficas. Cada video generado por sus modelos lleva una firma digital invisible e inalterable que certifica su origen sintético.

Esto condujo a la rápida adopción de herramientas de verificación. Para fines de 2026, los principales navegadores y aplicaciones de redes sociales ya integran detectores que pueden leer estas marcas de agua en tiempo real, etiquetando automáticamente el contenido como "Generado por IA". Los medios de comunicación serios no publican material audiovisual sin pasarlo por estos verificadores. Se ha convertido en una nueva capa de alfabetización mediática para la población.

El desafío, por supuesto, no ha terminado. La lucha ahora se centra en los videos generados por modelos de código abierto o maliciosos que no incluyen estas marcas de agua. Es una carrera armamentista tecnológica constante, pero la existencia de un estándar de verificación ha devuelto un grado de equilibrio.

—¿Cómo visualizas, desde tu experiencia en 2026, que la IA, con su creciente capacidad creativa (ej. generación de imágenes, música), ha impactado el trabajo de los artistas (músicos, diseñadores, escritores) en el pasado reciente (2024-2026)?

—El impacto en los artistas ha sido una dualidad compleja. Por un lado, la IA se ha establecido como una poderosa herramienta de co-creación; por otro, ha provocado la comoditización de una parte del mercado creativo.

Muchos artistas en 2026 no ven a la IA como un reemplazo, sino como un colaborador inagotable. Un músico de aquí, de Mendoza, puede estar atascado con una melodía y usar una IA para generar variaciones armónicas que le sirvan de inspiración para romper un bloqueo creativo. Un diseñador gráfico puede crear decenas de borradores para el logo de una bodega en minutos y luego usar su talento para refinar y conceptualizar la mejor opción. En este sentido, la IA acelera la fase de exploración y permite nuevas formas de expresión.

El desafío ha estado en el otro extremo. La demanda de contenido creativo más genérico, como música de fondo para videos corporativos, ilustraciones básicas para blogs o diseños simples, ha caído drásticamente para los creadores humanos, ya que la IA lo genera a un costo mínimo y con una calidad aceptable. Esto ha obligado a muchos artistas a redefinir su propuesta de valor, enfocándose más que nunca en la originalidad, la visión conceptual y una firma personal inconfundible que la IA, por ahora, no puede replicar.

—Con los avances en hardware, como el trabajo de Microsoft en IA cuántica y la partícula de Majorana, ¿qué impacto más tangible ya hemos visto en el ámbito de la ingeniería y la tecnología hasta 2026?

—El impacto más tangible de esa tecnología avanzada no lo hemos visto aún en un producto de consumo que uno pueda comprar, sino en la resolución de problemas de diseño de ingeniería que antes eran irresolubles. El avance se ha concentrado en la ciencia de materiales y la simulación molecular.

Los progresos en computación cuántica, que dependen críticamente de la creación de cúbits estables —el campo donde la investigación en partículas como la de Majorana es fundamental—, permitieron por primera vez simular sistemas químicos complejos con una precisión altísima.

El ejemplo más claro de esto ha sido en el diseño de nuevas baterías. Antes, desarrollar un nuevo tipo de electrolito era un proceso extremadamente lento de prueba y error físico en un laboratorio. Para 2026, las divisiones de I+D de empresas de ingeniería y tecnología ya utilizan la computación cuántica para simular miles de compuestos químicos a nivel atómico, pudiendo predecir su rendimiento y estabilidad antes de fabricar uno solo.

El resultado tangible es que los primeros prototipos de baterías de estado sólido, con una densidad energética y seguridad muy superiores a las de ion-litio de su época, y cuyo diseño fue radicalmente acelerado por estas simulaciones cuánticas, ya están en fase de prueba industrial avanzada. Ese es el impacto: una aceleración sin precedentes en la innovación de materiales de próxima generación.